Yapay Zeka’nın Karanlık Yüzü Mü Var?

Yapay Zeka’nın Karanlık Yüzü Mü Var? – Yapay zeka (AI), öğrenmemizde, çalışmamızda ve oyun oynamamızda devrim yaratıyor. AI, genellikle insan benzeri görevleri yerine getirme yeteneğine sahip makineleri gerektirir. Ancak, tüm bunların bir dezavantajı var mı?

Öte yandan, makine öğrenimi (ML), yapay zekaya ulaşmanın basit bir yoludur. Makine öğrenimi aynı zamanda programlamaya dayanmadan öğrenme sürecini de gerektirir. AI insanlığa yardımcı oluyor. Ancak bu yenilik bizim üzerimizde kişisel etkileri olan kararlar almaya başladığında normal hayatımızı etkileyebilir.

Yapay Zeka’nın Karanlık Yüzü Mü Var?

Yapay Zeka ve Makine Öğreniminin İnsanlar Üzerinde Olumsuz Etkileri Var mı?

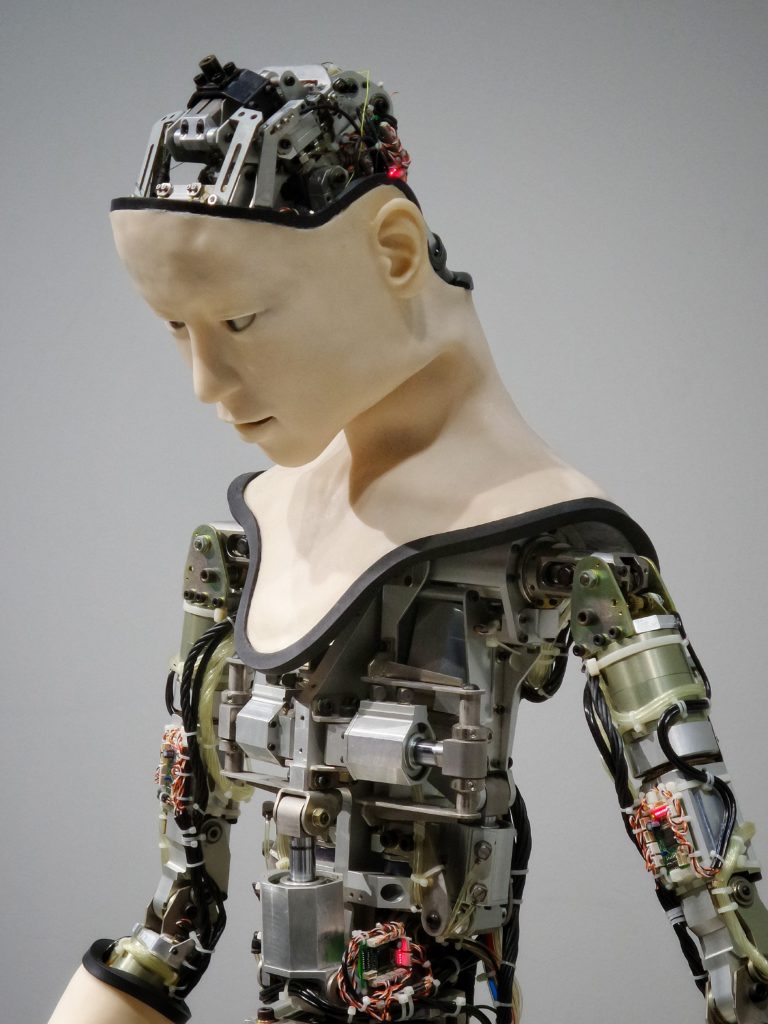

2029’a kadar bilgisayarların, insanları zekâsıyla alt edeceğine sahip dair tahminler var. Bu, bilgisayarların deneyimlerden öğrenebileceği ve birkaç dili kavrayabileceği anlamına gelir. Tıpkı bilgisayarlar gibi, robotların da insanlardan daha hızlı evrimleşmesi muhtemeldir, bu da bizi zekice alt eder.

Yapay zeka ile ilgili iyi olan şey, hayatı daha iyi hale getirmek için her zaman modern teknolojilerin bir kombinasyonunu bir araya getiriyor olmasıdır. Bu teknolojiler arasında sürücüsüz ulaşım ve sağlık sektöründe hedefe yönelik tedaviler yer alıyor. Ancak bu yenilik, bugün yaşama şeklimizi ve gelecekte nasıl yaşayacağımızı da etkiliyor. Örneğin, AI teknolojileri işimizin çoğunu üstleniyor. Veri gizliliği endişelerini artırıyor.

Yapay Zeka ve Makine Öğreniminin Yanlış Gideceği Yer

İnsanlar yapay zeka ile ilgili teknolojilerin hayatlarını nasıl değiştirdiği konusunda heyecan duyuyor. Ancak bu teknolojilerde neyin yanlış gidebileceğine bakma zamanı geldi. Şu an ve gelecekte, AI teknolojileri siber tehditler için fırsatları göz ardı edilemez. Ancak veri gizliliği endişelerini beraberinde getirir. Ayrıca aşağıda açıklandığı gibi etik ve ahlak kaygılarına, şeffaf olmama sorunlarına ve “kara kutu sorununa” da yol açabilirler.

Yapay Zeka’nın Karanlık Yüzü – Siber Saldırılar için Fırsat Yaratır

Siber güvenlik, AI teknolojilerinin hedeflediği görünen BT vektörlerinden biridir. Bununla birlikte, bilgisayar korsanlarının, yapay zeka geliştiricilerinin kötü amaçlı botlar geliştirmek için, siber güvenlik mekanizmaları tasarlamak için kullandıkları aynı yaklaşımları kullandığına dair endişeler var. Bilgisayar korsanları, AI sistemlerini kırmayı kolay buluyor. Çünkü kullanılan kodların kusurları var ve genellikle birkaç programlama metodolojisinin bir kombinasyonu.

AI teknolojileri, bilgisayar kullanıcılarının şifrelerini şüphelenmeyen kullanıcılara ifşa etmeleri için de alan yaratır. Bilgisayar korsanının, oturum açma kimlik bilgilerini çalmak isteyen bir bilgisayar kullanıcısına kolaylık sağlar. Bunu indirilebilir kötü amaçlı yazılım dosyaları göndermesine izin verebilirler. Bu teknik, bilgisayar korsanlarının otonom cihazlara erişmesine de izin verebilir.

Yapay Zeka’nın Karanlık Yüzü – “Kara Kutu” Sorunu

Yapay zeka uygulamaları, insan beyninin işleyişini taklit etmek için makine öğrenimi algoritmalarına veya sinir ağlarına güvenir. Sorun şu ki, bu algoritmaların doğru sonuçlar üretmeyi nasıl başardığını açıklamak imkansız. Bu “kara kutu sorunu”, yapay zeka ve makine öğreniminin karanlık taraflarından biridir. İnsanların yapay zeka uygulamalarının tabi olduğu otomatik karar verme süreciyle ilgili bilgilere erişememesi üzücü.

Şeffaflık Eksikliği

AI sistem tasarımcılarının, AI sistemlerine besledikleri girdi verilerinin türünü bize açıklamayı reddeden kararları ile ilgili endişeler var. Örneğin, Google arama motorunun mühendisleri, arama motorunun genellikle arama sonuçlarını nasıl sıraladığını açıklamaz. Şirket ticari sırları gibi süreçleri düşünüyor olabilirler. Yaptıkları, yapay zeka uygulamalarının şeffaf olması konusundaki beklentilerimize aykırı….

Yapay zeka uygulamalarında şeffaflık eksikliği, bu teknolojilerin hayatlarımızı gerçekten olumlu bir şekilde nasıl değiştirebileceğine dair spekülasyonlar doğurmaya başlıyor. Program tasarımcıları, yapay zeka tasarımlarının tescilli olduğunu iddia etse de, süreçlerini daha şeffaf hale getirme zamanı geldi. Bu basit politikaya bağlı kalmadaki başarısızlıkları, çoğu insanı gelecekteki AI teknolojilerine olan güvenini kaybetme konusunda negatif etki eder.

Değerler ve Ahlak

Farklı yaşam alanlarından insanlar, AI’nın geleceği ile ilgili etik sorular soruyor. Diğer yargı alanlarında, AI teknolojilerinin onları nasıl etkilediğine bağlı olarak insanların haklarını koruyan veri yasaları vardır. Bazı ülkelerde, şirketler ve bireyler bu katı politikalara uymadıklarında, cezai kovuşturmaya veya cezalara maruz kalabilirler.

Veri Gizliliği Kaygılarının Artması

Yeni AI uygulamaları dalgasıyla ilgili bir sorun, insanlardan çok fazla veri talep etmeleridir. Yapay zeka aracılığı ile makine öğrenimi teknolojilerinin, belirli kalıpları arayarak büyük veri kümelerini analiz etme sürecini basitleştirdiğini belirtmek gerekir. Bununla birlikte, verileri çıkarma süreci insanların mahremiyetini ihlal ettiğinde, bu teknolojilerin istilacı olmayı bırakma zamanı gelmiştir. Diğer yandan veri çıkarma süreci yalnızca insanlar buna rıza gösterdiğinde gerçekleşmelidir.

Veri toplayıcıların genellikle verilerini almadan önce insanlardan yüzlerce sayfalık sözleşme imzalamalarını istemeleri talihsiz bir durumdur. Çoğu kişi bu sözleşmelerin çoğunu aldığından Çevrimiçi politikalar, belgenin tamamını okuyup anlamaları zaman alabilir. Çoğu, sözleşme belgesinin gerektirdiklerini dikkatlice okumadan önce “kabul et” i tıklar. Böylece kişisel bilgilerini paylaşmayı kabul eder.

Yapay Zeka’nın Karanlık Yüzü Mü Var? – Son Söz

Uygun gözetimde değilse AI teknolojileri manipülatif olabilir. Yapay zeka ile ilgili karar alma süreçlerine rehberlik edebilecek etkili bir düzenleyici kanun oluştururken, birlikte çalışmak piyasa katılımcılarının, avukatların ve politika yapıcıların görevidir. Bu teknolojiler bizimle doğrudan etkileşime giriyor. Bu nedenle AI karar verme sürecini düzenlemede paydaşlara da katılmalıyız. Programlar bizden veri toplamadan önce, onlara yetki verme hakkına sahibiz.