Algoritmada Gizli Irkçılık ve Cinsiyetçilik

Her şeyden önce sosyal bir hayvan olan homo sapiens, hayatta kalma ve üreme için kritik öneme sahip ve hiç de kolay olmayan bir şeyi başarabiliyordu; sosyal işbirliği. Onu diğer türlerden farklı kılan buydu belki de. Büyük gruplar halinde, esnek işbirliğinin zorluğunu, “doğal” bir grubun sınırının 150 kişi olduğunu belirten sosyolojik araştırmalar da gösteriyor. Sayı 150’yi geçtiğinde işler değişiyor. Homo sapiens ise bu kritik eşiği aşıp şehirler, ülkeler kuruyor. Bunun sırrının kurgunun ortaya çıkması olduğu düşünülüyor. “Ortak bir mite inanan çok sayıda yabancı, başarılı işbirliği yapabilir.” diyor Yuval Noah Harari, Hayvanlardan Tanrılara Sapiens isimli kitabında.

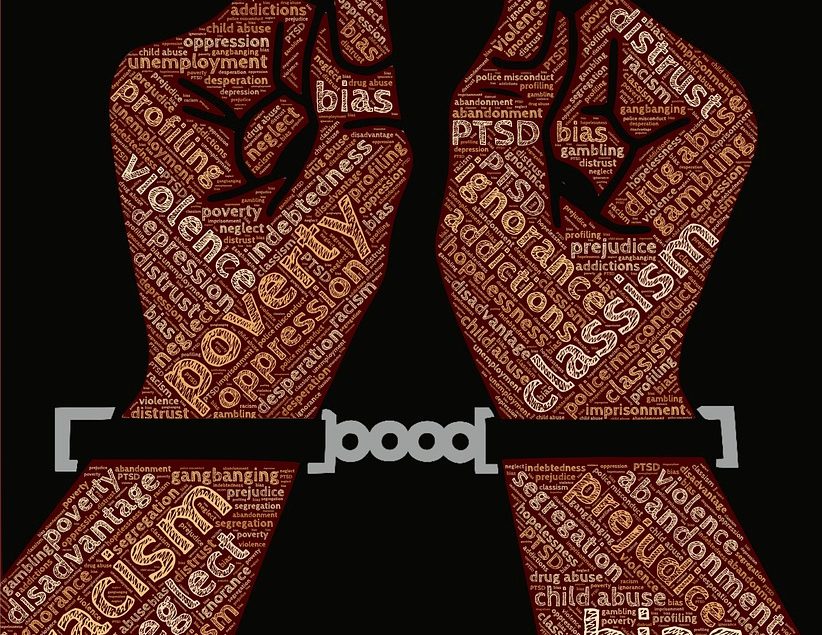

Türümüzü bir arada tutan, işbirliği yapmamızı sağlayan ve yalnızca üzerine düşünülüp hakkında konuşulduğu sürece var olabilecek mitlerimiz olan para, devlet, din gibi mitlerimizden, ırk ve ırkçılık üzerinden giriş yapıyoruz yazımıza.

Türümüzün devasa işbirliği ağlarının çoğunlukla gönüllü ve eşitlikçi olmadığı, baskı ve sömürüye dayalı olduğu hususlarını öncelikle belirtmek gerek diye düşünüyoruz. Eski Yunan’dan 20. yüzyıla değişen bir şey yok. Nitekim UNESCO’nun 1967’de Paris’te düzenlediği ‘Irkçılığın Tanımlanması Konferansı’ndan çıkan sonuca göre ırkçılık; işgalleri, köleliği ve sömürgeciliği haklı çıkartmak adına ortaya atılmış bir kuramdır.

@msecnd

Bugün Irkçılık Devam Ediyor Mu?

Peki ya Bilgi Çağı olarak adlandırılan, devrim niteliğinde teknolojik gelişmelerin ardı ardına yaşandığı 21. yüzyılda ırkçılık konusunda değişen ne?

Üzülerek söylüyoruz ki değişen, yalnızca insanların ezilme biçimleri. Irklara ilişkin algılarımız, tarım devrimi ve yerleşik hayata geçişimiz ile başlayan cinsiyetçi yaklaşımlarımız yerinde sayıyor. Bunu anlamanın en kolay yollarından biri, gündelik hayatımızda çok büyük yer kaplayan ve neredeyse tüm hayatımızı şekillendiren internet kullanımı.

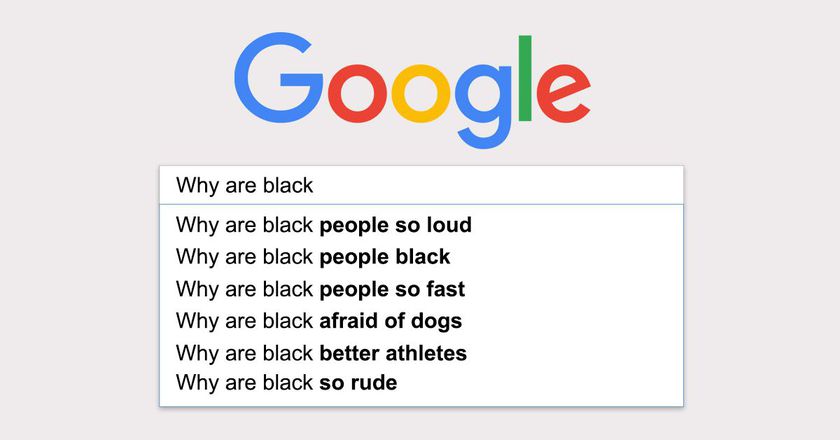

Bilgisayar programcılığının en önemli kısmı sayılan ve bir sorunun çözümü için izlenilecek yolu ifade eden algoritmaların, insanlar arasındaki çeşitliliği gözardı eden veritabanlarına dayanıyor olduğu endişesi git gide büyüyor. Bu konu üzerine araştırma yapan, kitaplar yazan insanların sayısı da günbegün artıyor. Güney Kaliforniya Üniversitesi’nde yardımcı doçent olan Safiya Umoja Noble de bu insanlardan biri. 2018 yılı başında yayınlanan “Baskı Algoritmaları” isimli kitabında ırk, sınıflar ve internet kesişimi üzerinden arama motorlarındaki algoritmanın tehlikelerine karşı uyarıda bulunuyor ve bunu devler liginin bir numarası olan Google üzerinden örneklendiriyor.

@distractify

Algoritmaların taraflı ve ön yargılı olduğunu savunan Noble, Google’ın arama motorunun ırkçılık konusuna karşı sorumluluk alması gerektiğine inanıyor. Noble, Google üzerinden “black girls” diye yapılan aramaların hızla porno sonuçlara yönlendirdiğini, başarılı kadın diye arama yapıldığında çok büyük oranda beyaz kadın imajlarıyla karşılaşıldığını ve daha pek çok örneği dile getiriyor. Bu mesele üzerine eğilen, Noble dışında farklı isimler de var.

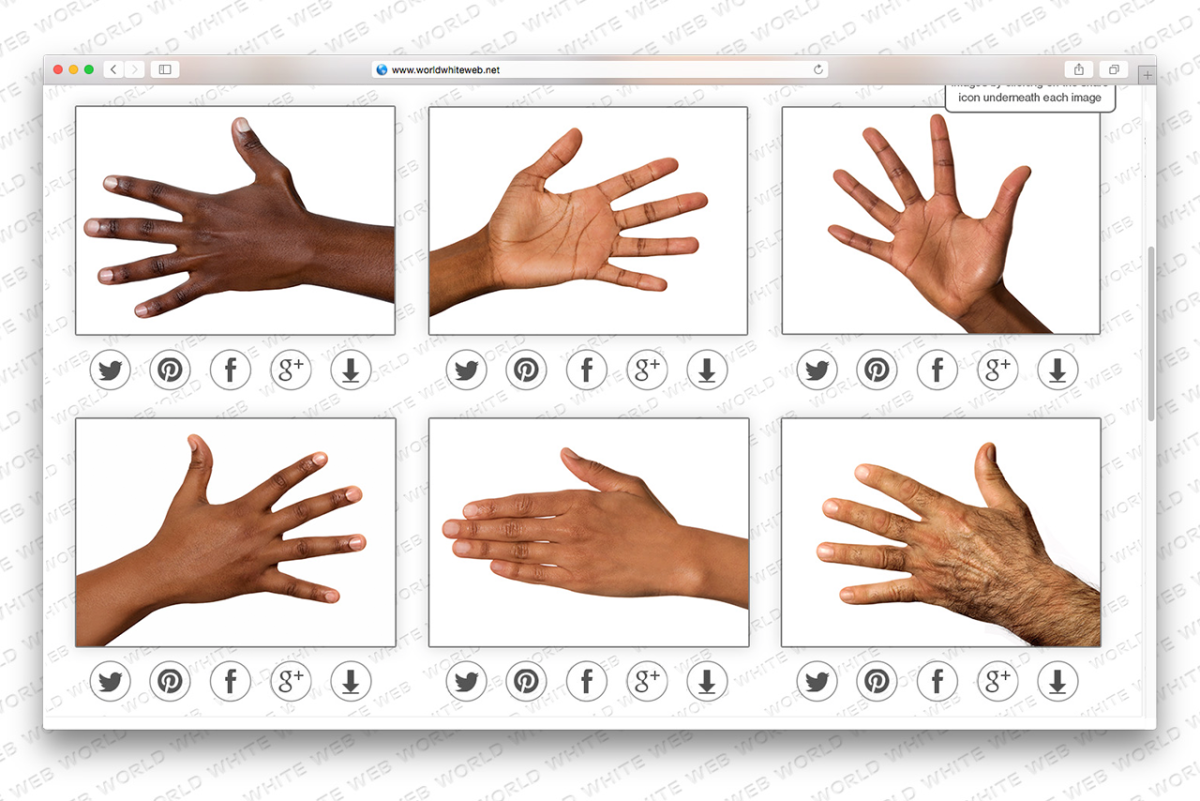

Algoritmalardaki Irkçılığa Karşı Projeler

Sorun yalnızca Google ille ilgili değil aslında. Herhangi bir arama motorunda “eller” ya da “bebekler” kelimelerini arattığımızda, görsellerde çoğunlukla beyaz insanlar çıkıyor karşımıza örneğin. Bu durumu fark eden grafik tasarımcı Johanna Burai, denge sağlanması amacıyla içerik üreticilere alternatif “el” fotoğrafları sunmak üzere; “World White Web Project” adlı internet sitesini kuruyor. Google’ın, görsel arama sonuçlarının kendi değerleriyle ilgisi olmadığı yönünde savunma yaptığını da belirtelim.

@tnwcdn

Farkındalık yaratan bir başka inisiyatif olan Algorithmic Justice League algoritmada adaletin sağlanması amacını güdüyor. İnisiyatifin kurucusu Massachusetts Teknoloji Üniversitesi’nde doktora yapan Joy Buolamwini isimli bir öğrenci. İnisiyatifin oluşum hikayesi ise son derece ilginç: Yüz tanıma programı olan bir yapay zekanın yüzünü tanımaması ve Buolamwini’nin beyaz maske kullanmak zorunda kalması. Hal böyle olunca, aşırı kilo ya da obezitesi olanlar ile yaşlılara yönelik yapay zeka teknolojilerinin nasıl çalıştığı da Buolamwini için merak konusu olmuş. Doğrusu biz de merak ediyoruz.

Boulamwini, Noble ve algoritmalardaki ayrımcılık meselesine kafa yoran çeşitli isimlere göre, dev teknoloji şirketlerinin her yıl yayınladığı “çeşitlilik raporları” da sorunun bir kaynağına işaret ediyor. Google’ın Ocak 2016’da paylaşılan raporunda, teknik çalışanların yalnızca yüzde 19’unun kadın olduğu, yüzde 1’inin siyahlardan oluştuğu; 2017’de yayınlanan raporunda ise çalışanların yüzde 91’inin beyaz veya Asyalı olduğu ile iş gücünün yüzde 31’inin kadınlardan oluştuğu bilgileri yer alırken şirketin teknoloji bölümlerinde durumun daha da vahim olduğu ve bu departmanların yüzde 20’sinin kadınlardan, yüzde 80’inin erkeklerden oluştuğu görülüyor. Yalnızca Google değil, Microsoft’un Eylül 2016’daki raporuna göre bu çalışanların yüzde 17.5’i kadın, yüzde 2.7’si siyah ya da Afrikalı Amerikalı ve yine Facebook’un Haziran 2016’da yayınladığı raporda ise ABD departmanının yüzde 17’sinin kadın ve yüzde 1’inin de siyahlardan oluştuğu belirtilmiş.

@1.medium

Irkçı Yapay Zeka Robotlar?

Yapay zekanın suça eğilimde siyahları öne koyması, 6 bin selfie üzerinden algoritmaların seçtiği güzellik yarışmasında kazanan 44 kişiden yalnızca bir tanesinin beyaz olmayışı ve az sayıda Asyalı bulunması ve diğer tüm örnekler algoritmaların nötr olmadığı kanısını güçlendiriyor. Uzmanlara göre, teknoloji şirketlerinin sorunun çözümü için daha çeşitli veri tabanları üreterek algoritmaları eğitmek, bu alışkanlığı yazılım ve program satıcıları arasında yaymak, algoritmaları kullanıcıları bilgilendirecek şekilde kurmak gibi atabileceği adımlar mevcut.

Karar verme süreçlerimizi ciddi şekilde etkileyen, beğenilerimizden yaşam biçimimize her şeyi belirleyen algoritmalar tarafsızlığımızı yitirmemize ve ön yargılı hareket etmemize de sebep oluyor. Bu algoritmaların benimsenmesi, normal kabul edilmesi tehlikesi ile karşı karşıyayız. Evet, tehlike! Türümüzün ön yargılısı bugünümüzü zehir ederken ön yargılarla geliştirilmiş olan yapay zeka ve robotların da geleceğimizi zehir ettiğini düşünmek dahi ürkütücü.